目录

快速导航-

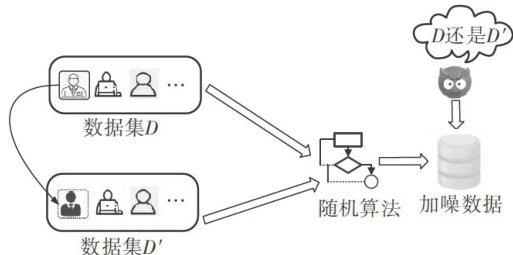

综述评论 | 推荐系统中的隐私保护:技术演进、评估框架与隐私效用协同发展

综述评论 | 推荐系统中的隐私保护:技术演进、评估框架与隐私效用协同发展

-

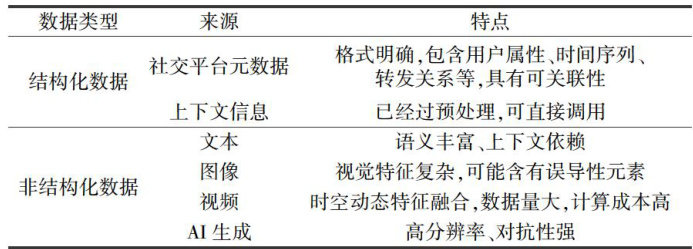

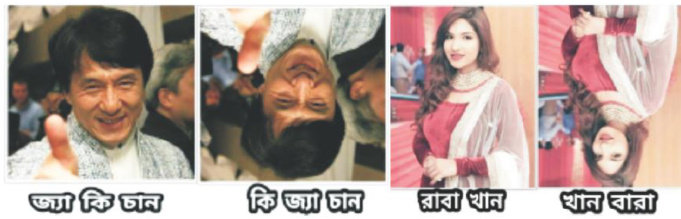

综述评论 | 基于多模态动态图学习的假新闻检测研究综述

综述评论 | 基于多模态动态图学习的假新闻检测研究综述

-

区块链技术 | 一种动态评估的去中心化跨链桥协议

区块链技术 | 一种动态评估的去中心化跨链桥协议

-

区块链技术 | MultiRelay:面向云边端架构的 动态多中继链跨链方案 中

区块链技术 | MultiRelay:面向云边端架构的 动态多中继链跨链方案 中

-

多模态融合专题 | 基于因果掩码控制与反事实干预机制融合的多模态仇恨模因检测

多模态融合专题 | 基于因果掩码控制与反事实干预机制融合的多模态仇恨模因检测

-

多模态融合专题 | 基于对抗训练与多模态自适应特征融合的情感分析

多模态融合专题 | 基于对抗训练与多模态自适应特征融合的情感分析

-

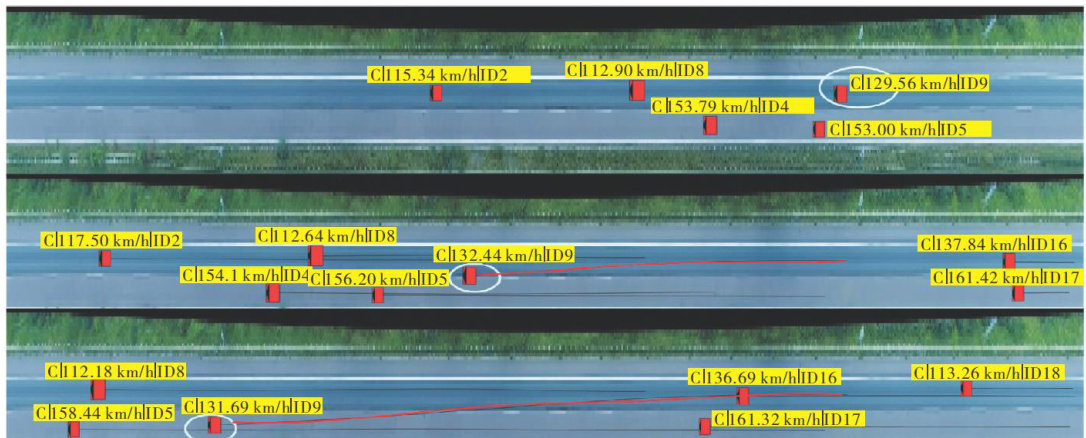

多模态融合专题 | 高速公路场景下的车辆换道意图预测研究

多模态融合专题 | 高速公路场景下的车辆换道意图预测研究

-

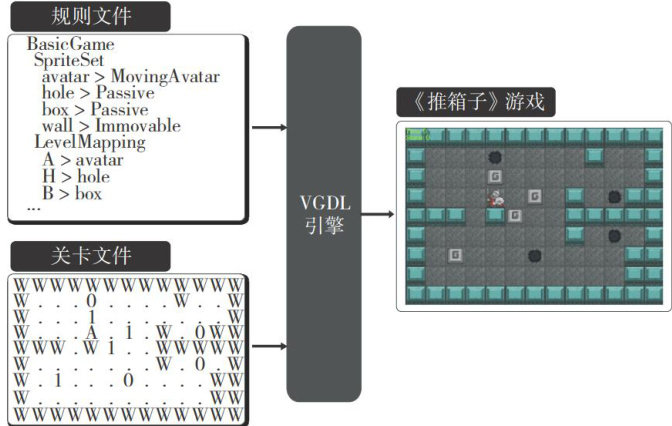

多模态融合专题 | 基于大语言模型的多模态互动内容人机协作创作

多模态融合专题 | 基于大语言模型的多模态互动内容人机协作创作

-

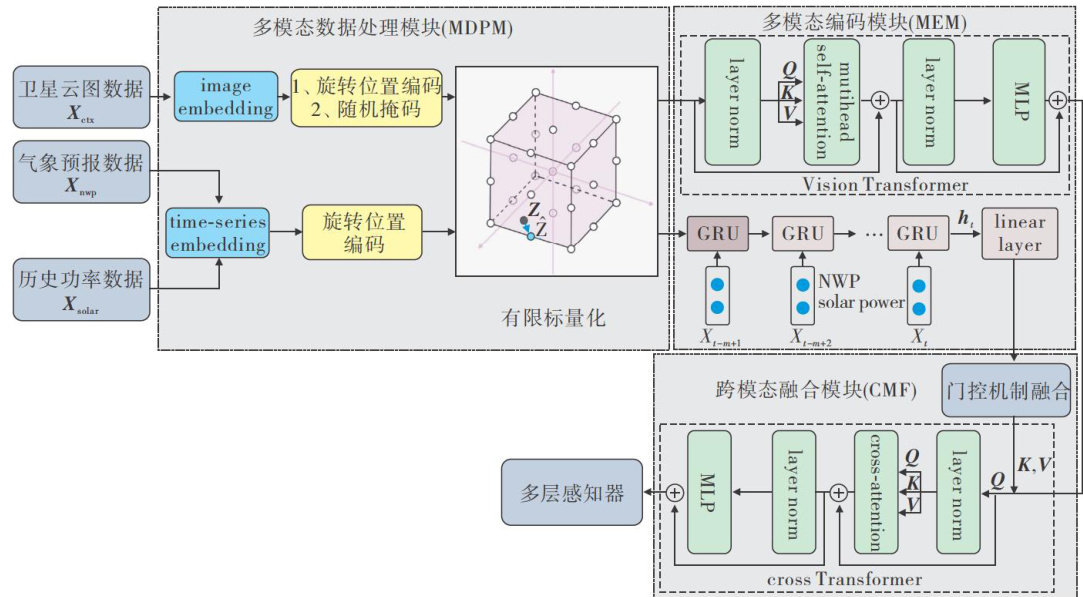

多模态融合专题 | 基于有限标量量化与分阶段跨模态注意力融合的光伏功率预测

多模态融合专题 | 基于有限标量量化与分阶段跨模态注意力融合的光伏功率预测

-

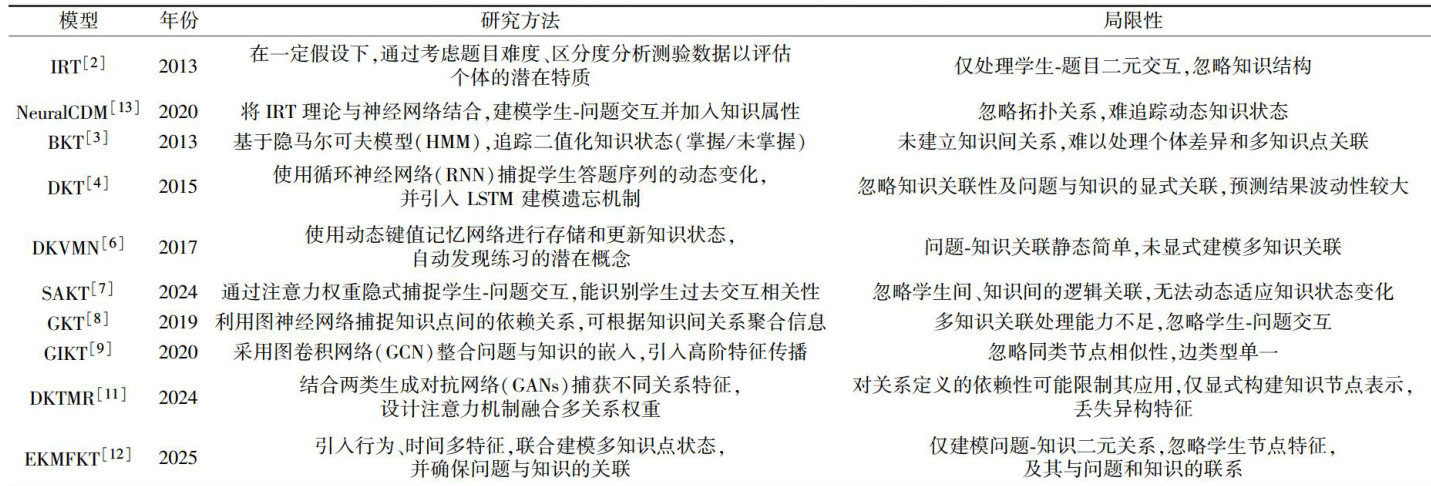

算法研究探讨 | 融合多维度特征的图卷积网络知识追踪模型

算法研究探讨 | 融合多维度特征的图卷积网络知识追踪模型

-

算法研究探讨 | 基于脉冲序列核的递归脉冲神经网络突触权值-延迟学习算法

算法研究探讨 | 基于脉冲序列核的递归脉冲神经网络突触权值-延迟学习算法

-

算法研究探讨 | 基于因果发现的业务流程概念漂移根因分析

算法研究探讨 | 基于因果发现的业务流程概念漂移根因分析

-

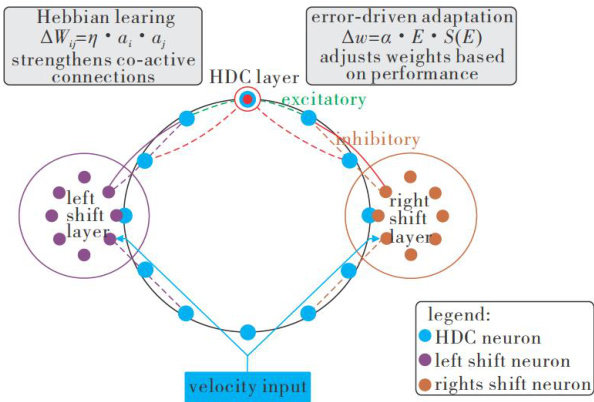

算法研究探讨 | 基于自适应环吸引子网络的基础数值计算模型

算法研究探讨 | 基于自适应环吸引子网络的基础数值计算模型

-

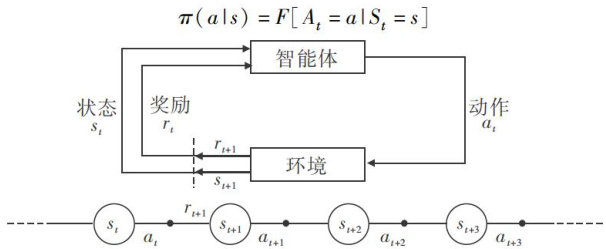

算法研究探讨 | 融合文本增强与深度强化学习的交互式推荐方法

算法研究探讨 | 融合文本增强与深度强化学习的交互式推荐方法

-

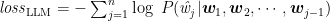

算法研究探讨 | 基于大语言模型的飞行轨迹预测方法

算法研究探讨 | 基于大语言模型的飞行轨迹预测方法

-

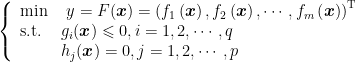

算法研究探讨 | 融合动态模糊扰动和特征引导的稀疏大规模多目标优化算法

算法研究探讨 | 融合动态模糊扰动和特征引导的稀疏大规模多目标优化算法

-

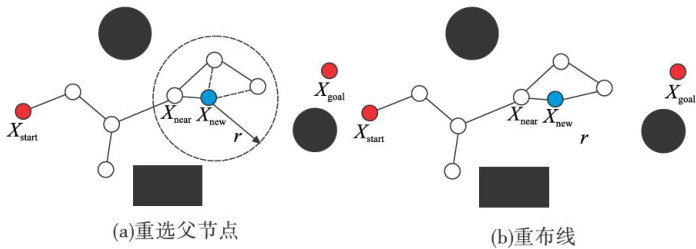

算法研究探讨 | 面向复杂城市环境的无人机动态航迹规划算法

算法研究探讨 | 面向复杂城市环境的无人机动态航迹规划算法

-

算法研究探讨 | 复杂环境下基于RRT\*引导MPPI的移动机器人路径规划

算法研究探讨 | 复杂环境下基于RRT\*引导MPPI的移动机器人路径规划

-

算法研究探讨 | 面向物联网安全的域映射增强与对抗增益聚合算法

算法研究探讨 | 面向物联网安全的域映射增强与对抗增益聚合算法

-

算法研究探讨 | 基于多视图多特征集成模型的EEG睡眠分期算法

算法研究探讨 | 基于多视图多特征集成模型的EEG睡眠分期算法

-

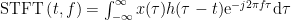

算法研究探讨 | 融合胶囊网络与细粒度语义匹配的多标签文本分类

算法研究探讨 | 融合胶囊网络与细粒度语义匹配的多标签文本分类

-

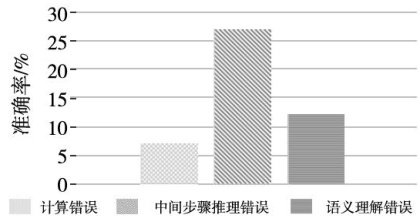

算法研究探讨 | 通过递进知识更新和自一致性增强大语言模型推理能力

算法研究探讨 | 通过递进知识更新和自一致性增强大语言模型推理能力

-

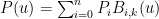

网络与通信技术 | 考虑故障因素的云服务器的最优策略及性能分析

网络与通信技术 | 考虑故障因素的云服务器的最优策略及性能分析

-

网络与通信技术 | 二维簇态上基于测量的量子网络编码

网络与通信技术 | 二维簇态上基于测量的量子网络编码

-

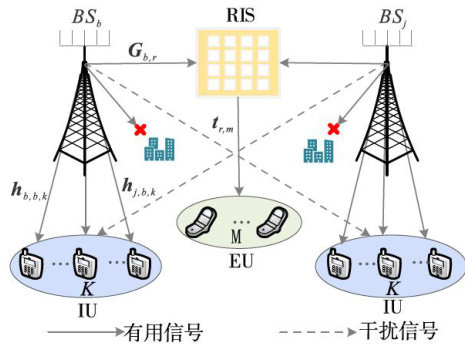

网络与通信技术 | RIS辅助的多小区无线信息能量协同传输方案

网络与通信技术 | RIS辅助的多小区无线信息能量协同传输方案

-

网络与通信技术 | 有源可重构网络中的联合波束优化与功率控制

网络与通信技术 | 有源可重构网络中的联合波束优化与功率控制

-

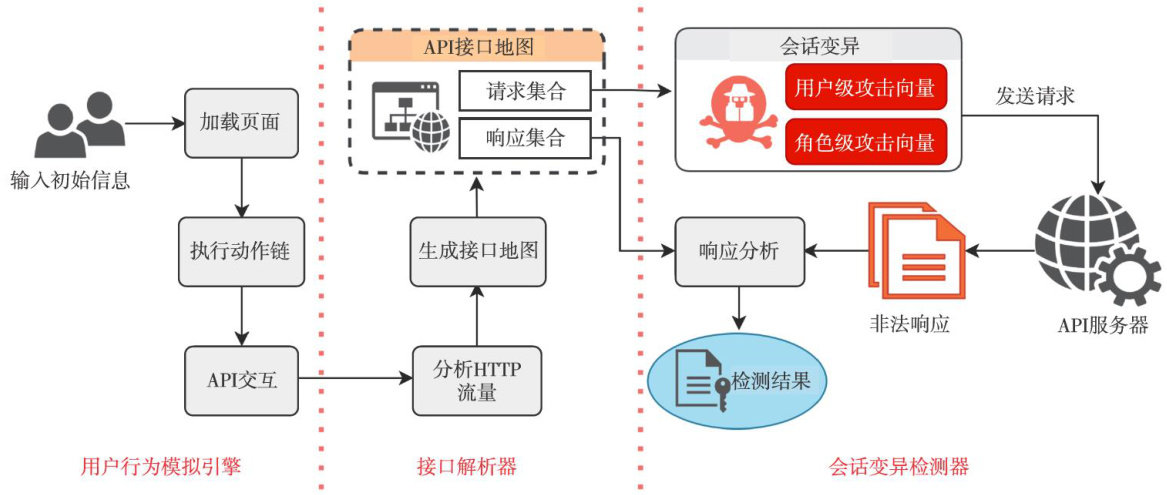

信息安全技术 | 基于动态行为链和会话变异的API访问控制漏洞自动化检测方法

信息安全技术 | 基于动态行为链和会话变异的API访问控制漏洞自动化检测方法

-

信息安全技术 | 异质性感知的自适应安全联邦聚合方法

信息安全技术 | 异质性感知的自适应安全联邦聚合方法

-

信息安全技术 | 基于安全洗牌的抗投毒攻击可验证联邦学习框架

信息安全技术 | 基于安全洗牌的抗投毒攻击可验证联邦学习框架

-

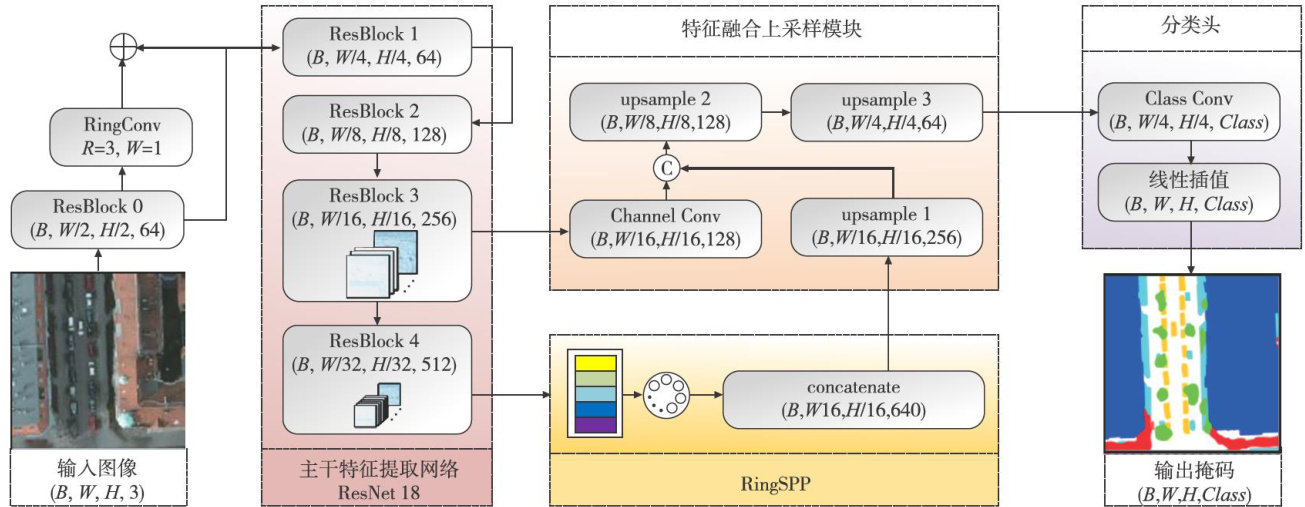

信息安全技术 | 基于非局域性正交乘积态的量子密钥协商协议

信息安全技术 | 基于非局域性正交乘积态的量子密钥协商协议

-

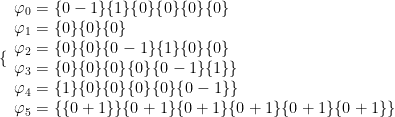

图形图像技术 | 面向开放场景的自适应阈值源相机识别算法

图形图像技术 | 面向开放场景的自适应阈值源相机识别算法

-

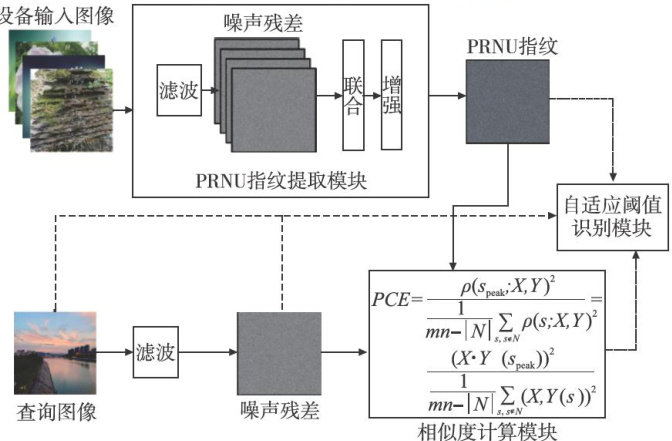

图形图像技术 | 基于多尺度注意力与动态软掩膜的无监督图像拼接方法

图形图像技术 | 基于多尺度注意力与动态软掩膜的无监督图像拼接方法

-

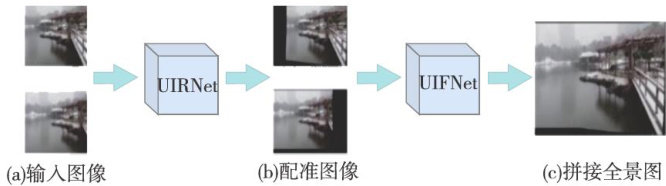

图形图像技术 | 基于环形卷积的遥感影像语义分割方法

图形图像技术 | 基于环形卷积的遥感影像语义分割方法

-

图形图像技术 | 集成重构与分割网络的工业异常无监督检测算法

图形图像技术 | 集成重构与分割网络的工业异常无监督检测算法

-

图形图像技术 | 复杂道路场景下智能驾驶单目3D车道线检测

图形图像技术 | 复杂道路场景下智能驾驶单目3D车道线检测

-

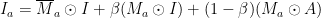

图形图像技术 | 基于边界增强和加权大核的多尺度 RGB-D显著性目标检测

图形图像技术 | 基于边界增强和加权大核的多尺度 RGB-D显著性目标检测

-

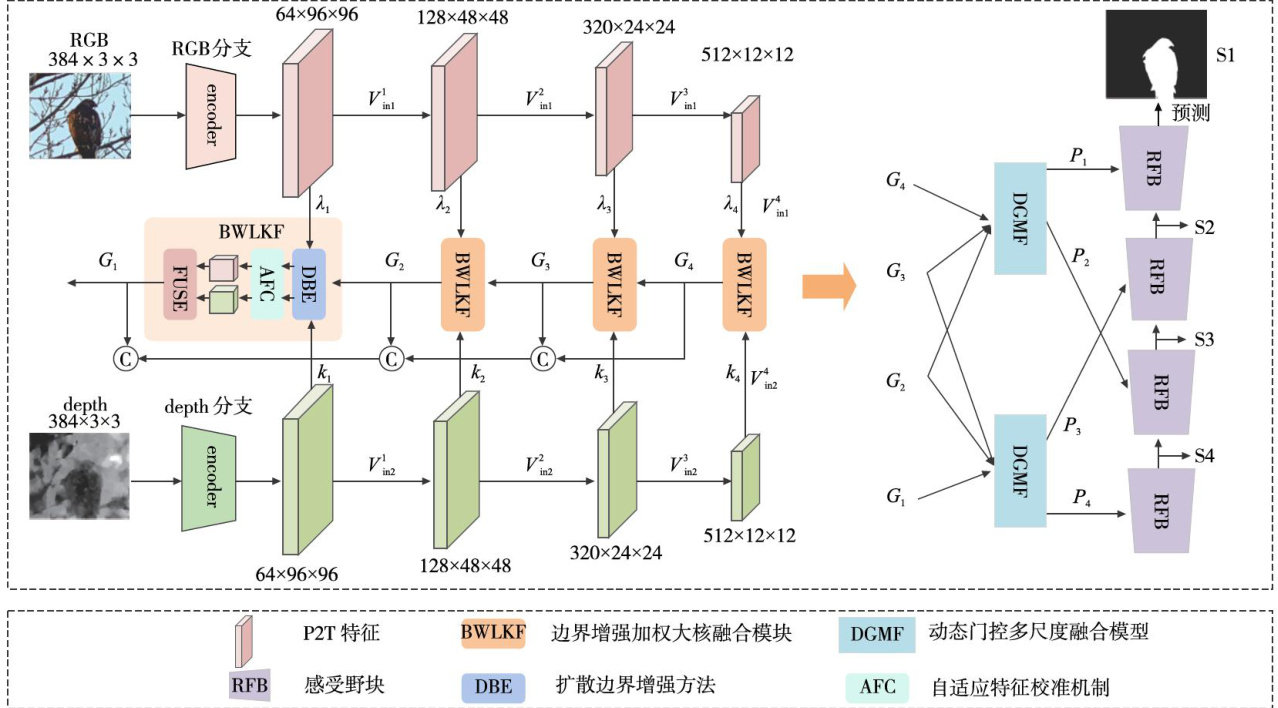

图形图像技术 | 基于BEV多模态特征融合的三维目标检测算法

图形图像技术 | 基于BEV多模态特征融合的三维目标检测算法

-

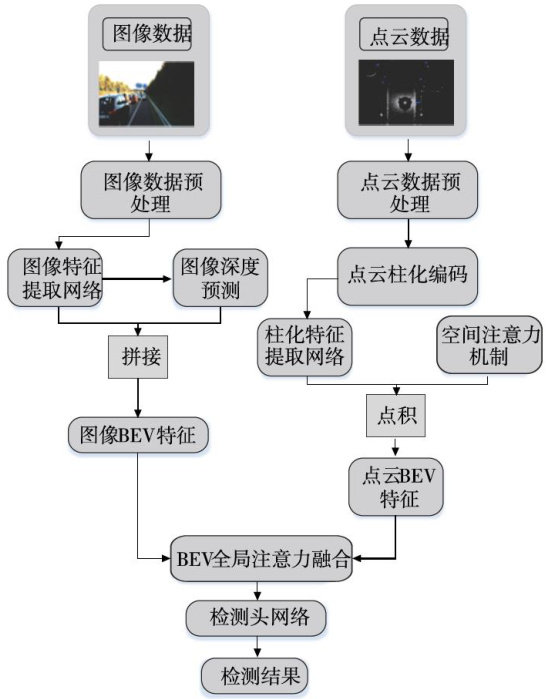

图形图像技术 | 一种面向手绘草图的多阶段跨域图像检索方法

图形图像技术 | 一种面向手绘草图的多阶段跨域图像检索方法

登录

登录